팔란티어 AIP 해부: AI를 "진짜 운영"에 연결하는 법

팔란티어의 제품 구조, Ontology 기반 AI 플랫폼(AIP)의 작동 원리, 비즈니스 모델, 그리고 이 회사가 AI 시대에 독보적인 위치를 점하는 이유와 한계를 분석한다

AI 회사들이 “우리도 엔터프라이즈 AI 한다”고 할 때, 대부분은 RAG 파이프라인에 사내 문서를 던져넣는 수준이다. 팔란티어는 다른 얘기를 한다. “AI가 문서를 읽는 게 아니라, 기업의 운영 시스템을 직접 조작해야 한다.”

2003년 CIA 벤처펀드로 시작해서, 20년간 정보기관과 군대의 데이터를 통합해온 회사가 2023년 AIP를 출시하면서 상업 시장에서 폭발적으로 성장하고 있다. FY2025 매출 $44.8억(+56% YoY), 미국 상업 부문만 Q4 기준 YoY +137%. 이 숫자가 나온 구조를 분해해본다.

팔란티어가 파는 것: 4개 제품

팔란티어의 제품은 4개다. 각각이 독립적이면서도, **Ontology(온톨로지)**라는 공유 레이어로 연결된다.

| 제품 | 출시 | 한 줄 정의 | 타겟 |

|---|---|---|---|

| Gotham | 2008 | 국방/정보기관용 데이터 분석 플랫폼 | CIA, 미 육군, NATO |

| Foundry | 2016 | 기업용 데이터 운영 플랫폼 | Airbus, Merck, NHS |

| Apollo | 2021 | 소프트웨어 배포/인프라 플랫폼 | 내부 + 정부/기업 |

| AIP | 2023 | LLM을 Ontology에 연결하는 AI 플랫폼 | 전체 고객 |

핵심은 AIP가 “새로운 독립 제품”이 아니라는 점이다. Foundry/Gotham 위에 얹는 AI 레이어다. Ontology가 없으면 AIP도 없다. 이 구조가 팔란티어의 해자이자 약점이다.

Ontology: 팔란티어의 진짜 핵심

모든 제품을 관통하는 개념이 Ontology다. 쉽게 말하면, 기업의 모든 데이터를 “비즈니스 오브젝트”로 구조화하는 레이어다.

ERP에 있는 생산 데이터, MES의 설비 상태, CRM의 고객 정보가 각각 다른 시스템에 흩어져 있다. Ontology는 이걸 “생산 라인”, “설비”, “고객 주문”이라는 **오브젝트(Object)**로 추상화하고, 이들 사이의 관계(링크)와 가능한 행동(액션)을 사전에 정의한다.

Ontology 3계층

| 계층 | 역할 | 예시 |

|---|---|---|

| Semantic | 데이터의 “무엇”을 정의 | ”항공기” 오브젝트, “운항 상태” 속성, “소속 항공사” 링크 |

| Kinetic | 데이터에 대한 “행동”을 정의 | ”생산 라인 정지” 버튼 → 실제 MES에 명령 전달 |

| Dynamic | 비즈니스 룰과 거버넌스 | 승인 체계, 접근 권한, 워크플로우 생명주기 |

이 3계층이 왜 중요한지는 AIP에서 드러난다.

AIP: AI를 Ontology에 연결하는 방법

팔란티어 AIP의 핵심 주장은 이렇다:

“LLM이 비정형 문서를 검색하는 것(RAG)보다, 이미 구조화된 비즈니스 오브젝트에 접근하는 것(OAG)이 hallucination이 적고, 실제 운영 자동화까지 연결된다.”

**OAG(Ontology Augmented Generation)**라는 이름을 붙였다.

기존 RAG: 질문 → 유사 문서 검색 → LLM 답변 (텍스트)

OAG: 질문 → Ontology 오브젝트 조회 → LLM 추론 → 실제 시스템 Action 실행차이점은 마지막 단계다. RAG는 답변을 생성하고 끝나지만, OAG는 Ontology의 Action을 트리거한다. “납기 지연 위험 주문을 찾아서 물류팀에 알림 보내고 대안 경로 제안해” 같은 요청이 실제로 시스템을 움직인다.

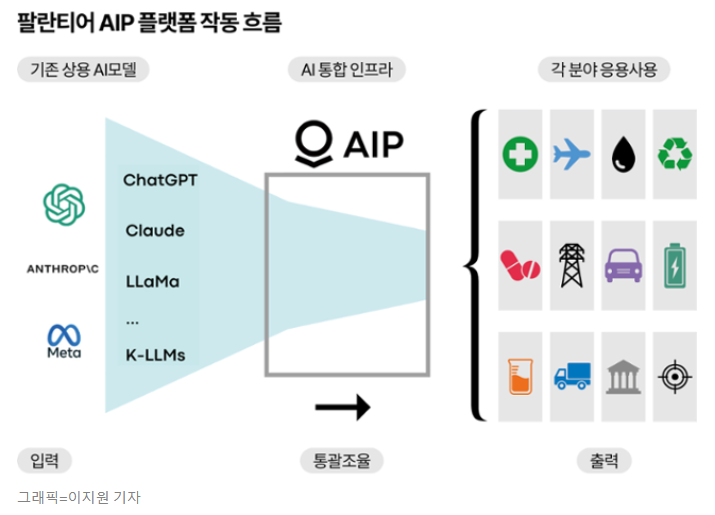

AIP 플랫폼 작동 흐름

이 다이어그램이 AIP의 구조를 잘 보여준다.

입력 (왼쪽): ChatGPT, Claude, LLaMA, K-LLM 등 기존 상용 AI 모델들. 팔란티어는 특정 LLM에 종속되지 않는 모델 애그노스틱 구조다. OpenAI, Anthropic, Google, Meta, NVIDIA Nemotron 모두 플러그인 형태로 연결된다.

AI 통합 인프라 (중앙): AIP가 이 자리에 있다. 다양한 LLM을 받아서, Ontology를 통해 기업의 운영 데이터와 연결하고, 보안/감사/권한 관리를 적용한다. 핵심은 LLM이 직접 데이터에 접근하는 게 아니라, Ontology라는 “통제된 창구”를 통해서만 접근한다는 것이다.

출력 (오른쪽): 의료, 항공, 에너지, 환경, 제약, 전력, 자동차, 배터리, 물류, 금융 등 각 분야별 응용. 하나의 AI 인프라로 다양한 산업의 운영 워크플로우를 구동한다.

즉 AIP의 가치 제안은: **“어떤 LLM이든 연결하고, 어떤 산업이든 적용하되, 중간에 Ontology라는 구조화된 통제 레이어를 둔다”**는 것이다.

AIP의 빌더 도구 3종

AIP는 AI 워크플로우를 만드는 빌더 도구와, 최종 사용자가 쓰는 앱으로 나뉜다.

1. AIP Logic — AI 함수 빌더

“LLM 기반 함수를 구축, 테스트, 릴리즈하는 노코드 개발 환경”

AIP Logic의 기본 단위는 Logic Function이다. Ontology 오브젝트나 텍스트를 입력받아, 값/오브젝트/Ontology 편집을 출력한다.

Logic Function은 Block이라는 조합 가능한 단위로 구성된다. 한 Block의 출력이 다음 Block의 입력이 된다.

| Block 유형 | 기능 |

|---|---|

| Create Variable | 변수 생성/데이터 조작 |

| Apply Action | Ontology 액션 실행 (데이터 쓰기, 시스템 명령) |

| Execute Function | 다른 함수 호출 |

| Use LLM | LLM 호출. 프롬프트 구성, 도구(Tool) 연결 |

| Read/Write Ontology | Ontology 데이터 읽기/쓰기 |

예시: 공급망 중단 대응 봇이라면:

Read OntologyBlock → 이메일에서 언급된 부품 오브젝트 조회Use LLMBlock → 과거 유사 사례 검색 + 솔루션 추론Apply ActionBlock → 추천된 대안 공급사에 자동 발주 요청

인터페이스는 3패널 구조다:

- 좌측: 입력/블록/출력 구성

- 중앙: 디버거 — LLM의 Chain-of-Thought 추론 과정을 그대로 표시

- 우측: 실행 패널 — 샘플 출력 생성, 테스트 저장

Logic Function을 발행(publish)하면 Evaluation 시스템으로 모델 비교(GPT-4 vs GPT-3.5), 출력 일관성 검증, 프롬프트 디버깅이 가능하다. Workshop 앱에서 호출하거나, AIP Automate로 스케줄/트리거 기반 자동 실행도 된다.

2. AIP Assist — 대화형 AI 어시스턴트

Logic이 “개발자용 빌더”라면, Assist는 **“모든 사용자가 쓰는 AI 어시스턴트”**다.

Foundry 플랫폼 내에서 작동하며, 사용자가 현재 작업 중인 도구/데이터의 맥락을 인식한다. Code Repositories에서 코드 짤 때 AI가 도와주고, Pipeline Builder에서 변환 로직 설계할 때 최적 접근법을 추천하고, 자연어로 “지난 분기 매출 상위 10개 제품?”이라고 물으면 분석 결과를 반환한다.

Logic vs Assist 차이:

| AIP Assist | AIP Logic | |

|---|---|---|

| 성격 | 대화형 어시스턴트 | 워크플로우 빌더 |

| 사용자 | 모든 Foundry 사용자 | 개발자 |

| 출력 | 자연어 응답, 코드, 분석 결과 | 구조화된 값, Ontology 편집 |

| 자동화 | 일회성 지원 | Automate 연동으로 반복 실행 |

| 프로덕션 | 탐색/분석/지원 용도 | 운영 워크플로우에 직접 통합 |

Assist는 “찾아보고 알려주는” 도구이고, Logic은 “만들어서 돌리는” 도구다.

3. AIP Agent Studio — AI 에이전트 빌더

Agent Studio는 Assist와 Logic을 에이전트 패러다임으로 통합한다. LLM + Ontology + 문서 + 커스텀 도구를 결합한 AI 에이전트를 구축한다.

팔란티어는 4단계 성숙도 모델을 제시한다:

| 단계 | 설명 |

|---|---|

| Tier 1 | Ad-hoc 분석. AIP Threads로 문서 분석/기본 LLM 상호작용 |

| Tier 2 | 태스크 특화 에이전트. Ontology/문서 백엔드로 재사용 가능한 에이전트 구축 |

| Tier 3 | 에이전틱 앱. Workshop 앱에 에이전트를 통합. 앱 상태를 읽고 업데이트 |

| Tier 4 | 자동화 에이전트. 함수로 발행하여 AIP Automate에서 자율 실행 |

Tier 1에서 시작해서 Tier 4까지 점진적으로 확장하라는 게 공식 권장이다. 처음부터 완전 자동화를 목표로 하지 말라는 뜻.

Foundry 전체 스택: AIP가 앉는 자리

AIP만 따로 떼어서 보면 맥락이 빠진다. Foundry 전체 스택에서 AIP의 위치를 봐야 한다.

외부 데이터 소스 (ERP, CRM, MES, 센서, API)

│

▼

┌───────────────────────────────────┐

│ 데이터 통합 (Data Integration) │

│ 500개+ 커넥터, 배치/스트리밍 │

│ Pipeline Builder, Code Repos │

└──────────────┬────────────────────┘

│

▼

┌───────────────────────────────────┐

│ 온톨로지 (Ontology) │

│ Objects ─ Links ─ Actions │

│ Functions ─ Side Effects │

└──┬──────┬──────┬──────┬──────────┘

│ │ │ │

▼ ▼ ▼ ▼

분석 앱개발 모델통합 AIP

(Contour (Workshop (Model (Logic,

Quiver Slate Studio Assist,

Fusion) Carbon) Live) Agent)데이터 통합 레이어가 외부 시스템에서 데이터를 수집하고, Ontology가 이를 비즈니스 오브젝트로 구조화한다. 그 위에서 분석, 앱 개발, ML 모델, AI가 각각 작동하되 모두 같은 Ontology를 공유한다.

이 구조 때문에 AIP Logic의 “Use LLM” Block이 Ontology 오브젝트를 직접 읽고, “Apply Action” Block이 실제 시스템을 움직일 수 있는 것이다. Ontology 없이 LLM만 단독으로 돌리는 게 아니라, 기업의 전체 데이터 인프라 위에서 AI가 작동한다.

비즈니스 모델: 어떻게 돈을 버나

수익 구조

팔란티어는 순수 SaaS도, 순수 컨설팅도 아닌 고비용-고착도 하이브리드다.

- 소프트웨어 구독/라이선스 (주력) — 멀티년 계약, 가격은 전량 협상

- 프로페셔널 서비스 — FDE(Forward Deployed Engineer) 파견 비용 포함

- 마켓플레이스 — AWS/Azure를 통한 AIP 배포

공개 가격표는 없다. 정부 계약은 수천만수억 달러(영국 MoD £2.4억, NHS £3.3억), 기업 계약은 pilot 수십만 달러에서 확장 시 연 $1M$100M+.

재무 실적

| 연도 | 매출 | YoY | 조정 영업이익률 |

|---|---|---|---|

| FY2023 | $22.3억 | +17% | ~22% |

| FY2024 | $28.7억 | +29% | ~35% |

| FY2025 | $44.8억 | +56% | 50% |

| FY2026 가이던스 | $71.9억 | +61% | - |

FY2023→FY2025 사이에 성장률이 17%→56%로 뛴 건 AIP 효과다. Rule of 40은 81%로 업계 최상위.

매출 구성

정부 55% vs 상업 45% (FY2024 기준). 상업 비중이 빠르게 확대 중이고, 특히 미국 상업 부문이 Q4 2025 기준 YoY +137%로 폭발하고 있다.

GTM: 어떻게 파나

Forward Deployed Engineers (FDE)

팔란티어의 가장 독특한 판매 방식이다. 자사 엘리트 엔지니어를 고객 현장에 파견하여 수 주 만에 production-ready 워크플로우를 구축한다.

전통 엔터프라이즈 SW가 SI 파트너를 통해 6~18개월 걸리는 걸, 자사 엔지니어가 현장에서 관찰하며 수 주 만에 끝낸다. 문제는 확장성이다. 고객이 늘면 엔지니어도 비례해서 늘어야 한다.

AIP Bootcamp — FDE 병목의 해법

2023년 도입한 GTM 혁신이다. 잠재 고객을 1~5일 집중 워크숍에 초대해서, 자사 데이터로 AI 프로토타입을 직접 빌드하게 한다.

- 누적 1,300회+ 완료, 465개 조직 참여

- CAC 회수 기간: 5.7개월 (역대 최고)

- 전통 세일즈 사이클(3~12개월) → 수 주로 압축

고객이 직접 만져보고 나면 계약 전환이 빠르다. Fortune 500 산업체가 초기 계약 5배 확장, Fortune 100 리테일이 pilot 후 연 $1,200만 계약으로 전환한 사례가 공개되어 있다.

Pilot → Expand → Lock-in

소형 pilot → FDE 파견/결과 생성 → 확장 계약 → 플랫폼 락인.

데이터와 워크플로우가 Ontology에 축적될수록 전환 비용이 기하급수적으로 증가한다. Net Dollar Retention 124%는 기존 고객이 매년 24% 더 쓴다는 뜻이다.

주요 고객과 계약

정부

| 고객 | 계약 | 규모 |

|---|---|---|

| 미 육군 | 10년 통합 SW/데이터 | $100억 |

| DoD Maven | AI/ML 역량 확장 | $13억 |

| 영국 MoD | 국방 데이터 플랫폼 | £2.4억 |

| NHS England | 환자 데이터 플랫폼 (7년) | £3.3억 |

| NATO | Maven Smart System 도입 | 비공개 |

미 5개 군 모두와 계약 관계 유지, NATO까지 확장. 서방 국방 AI 인프라의 사실상 독점 공급자를 향한 진전.

기업

총 고객 수 769개(+39% YoY). 항공(Airbus), 제약(Merck), 에너지(BP), 금융(Morgan Stanley), 보험(SOMPO) 등. 대부분 NDA로 비공개.

경쟁 해자: 강한 것과 약한 것

강한 해자

- Ontology: 수년에 걸쳐 구축된 구조화 데이터 모델. 단순 복제 불가

- 정부 보안 인증: IL6(최고기밀) 레벨. 신규 진입자가 수년 걸리는 허들

- Apollo: air-gap(인터넷 차단) 포함 전 환경에 동시 배포 가능한 유일한 솔루션

- 전환 비용: Ontology에 운영 데이터가 깊이 연결될수록 이탈 불가능

- 20년 정부 신뢰: CIA 창업 자금부터의 실전 검증

약한 해자

- 일반 상업 시장: Snowflake/Databricks 대비 가격 경쟁력 열위

- 국제 시장: 유럽 성장률 ~20% YoY로 미국(+137%)에 비해 현저히 부진

- LLM 고도화: 모델이 강력해질수록 Ontology 같은 구조화 레이어의 필요성이 감소할 수 있음

- Microsoft 번들: Fabric + Azure OpenAI가 기존 MS 생태계 고객을 흡수

경쟁 포지션

팔란티어는 스스로를 **“Snowflake/Databricks 위에 앉는 의사결정 실행 레이어”**로 정의한다.

| Palantir | Snowflake | Databricks | MS Fabric | |

|---|---|---|---|---|

| 포지션 | AI 의사결정 OS | 데이터 클라우드 | ML 플랫폼 | 통합 데이터 |

| Ontology | 핵심 차별점 | 없음 | 없음 | 없음 |

| 정부 보안 | IL6 | IL4 | IL4 | IL5 |

| FY2025 ARR | $44.8억 | ~$40억 | ~$40억 | N/A |

| YoY | +56% | ~26% | ~50% | - |

이 포지셔닝이 맞다면 경쟁이 아니라 공생이다. Snowflake가 데이터를 저장하고, Databricks가 ML을 돌리고, 팔란티어가 그 위에서 의사결정을 실행하는 구조. 문제는 대형 클라우드 벤더들이 같은 레이어로 올라올 때다.

리스크: 무시하면 안 되는 것들

밸류에이션

TTM P/E ~220배, Forward P/E ~103배. S&P 500 평균이 25~30배인 걸 생각하면 극단적 프리미엄이다. FY2026 목표를 완벽히 달성해도 P/E는 여전히 110배. “완벽한 실행 + 시장 기대 지속 초과”가 전제되어야 유지 가능한 주가다.

윤리적 논란

- ICE(이민세관집행국) $3,000만 계약 — 불법 이민자 추적

- 전 직원 13명 공개 서한(2025년 5월) — “설립 원칙 위반”

- NHS 환자 데이터 프라이버시 논란

- 영국 MoD 회전문 인사 비판

이건 구조적으로 해소될 수 없는 리스크다. 정보기관/법집행기관이 핵심 고객인 이상, “도구는 중립적”이라는 논리만으로는 논란이 사라지지 않는다.

정부 의존도

정부 매출 비중 ~54%. 미 정부가 그 중 ~80%. 예산 삭감이나 정치적 변동에 직접 노출된다. DOGE(정부 효율화) 기조의 역설도 있다: 팔란티어가 DOGE 도구로 활용되면서, 동시에 DOGE가 팔란티어 고객 부처의 예산을 깎고 있다.

Ontology의 장기 리스크

팔란티어의 전체 해자가 Ontology에 의존한다. 그런데 LLM이 더 강력해지면? GPT-5, Claude 다음 세대가 비정형 데이터에서 직접 운영 추론을 할 수 있게 된다면, Ontology라는 “사전 구조화” 레이어의 필요성이 줄어들 수 있다. 이게 진짜 장기 리스크다.

정리

팔란티어는 “AI 모델을 만드는 회사”가 아니다. **“AI 모델이 기업의 운영 시스템을 안전하게 조작할 수 있게 해주는 인프라”**를 만드는 회사다.

AIP 플랫폼 작동 흐름이 이걸 명확히 보여준다: 왼쪽에서 어떤 LLM이든 받아서, 중앙의 AIP(Ontology 기반 통제 레이어)를 거쳐, 오른쪽의 다양한 산업 운영에 연결한다. 모델은 범용이지만, 모델과 현실 세계 사이의 연결은 기업별 맞춤이어야 한다는 게 팔란티어의 베팅이다.

이 베팅이 맞다면, 팔란티어는 AI 시대의 운영 체제가 된다. 틀리다면 — LLM이 Ontology 없이도 직접 운영을 다룰 수 있게 된다면 — 세계에서 가장 비싼 미들웨어가 된다.

현재 실적은 전자를 가리키고 있다. 밸류에이션은 그 이상을 요구하고 있다.

← All posts